31.03.2026

Aktualisiert 08.04.2026

Threat

Prompt Injection

Prompt Injection bei KI-Agenten beschreibt direkte und indirekte Manipulation über Prompts, Dokumente, Webseiten oder Tool-Outputs und zeigt Risiken, Detection und konkrete Schutzmaßnahmen.

Schnellantwort

- Was betroffen ist

- Betroffen sind vor allem KI-Agenten, die untrusted Inhalte lesen und zugleich mit Tools, RAG, Browsern, E-Mail, Dokumenten oder externen APIs arbeiten.

- Warum es gefährlich ist

- Prompt Injection verändert nicht nur Textausgaben, sondern kann Planung, Tool-Wahl, Datenzugriffe und Folgeaktionen umlenken. Je mehr Rechte der Agent hat, desto größer wird der Schaden.

- Wie es passiert

- Entweder direkt über manipulierte Nutzereingaben oder indirekt über Webseiten, PDFs, E-Mails, Repos, Screenshots oder Tool-Outputs, die der Agent später verarbeitet.

- Wie man es reduziert

- Wirksam ist nur ein Control Stack aus Trennung von trusted und untrusted Kontext, Input Validation, Least Privilege, Output- und Tool-Checks, Human Approval und guter Telemetrie.

Was ist Prompt Injection bei KI-Agenten?

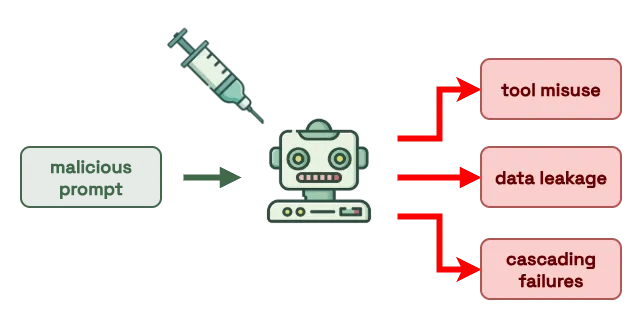

Prompt Injection bei KI-Agenten ist ein Angriffsmuster, bei dem ein Modell durch direkte Eingaben oder durch untrusted Inhalte aus externen Quellen dazu gebracht wird, seinen eigentlichen Auftrag oder höher priorisierte Sicherheitsregeln zu missachten. Bei agentischen Systemen ist das deutlich kritischer als bei einem einfachen Chatbot, weil der Agent nicht nur antwortet, sondern plant, Tools aufruft, Daten liest und Aktionen in anderen Systemen auslöst.

Das Kernproblem ist nicht nur ein “böser Prompt”, sondern die fehlende harte Trennung zwischen Daten und Anweisungen. Wenn Webseiten, Dokumente, E-Mails, Tool-Outputs oder RAG-Treffer in denselben Entscheidungsraum gelangen wie Systemregeln und freigegebene Nutzeraufträge, kann fremder Inhalt die Zielsteuerung des Agenten beeinflussen.

In der Threat-Landschaft liegt Prompt Injection deshalb im Input- und Context-Manipulation-Layer. Sie ist häufig der Eintrittspfad für spätere Folgen wie Tool Misuse und Exploitation, Memory and Context Poisoning, Agent Goal Hijack oder Identity and Privilege Abuse.

Besonders exponiert sind:

- RAG- und Search-Agents

- E-Mail-, Dokumenten- und Workspace-Assistenten

- Browser- und Computer-Use-Agents

- Coding Agents mit Repo-, Shell- oder Dateisystemzugriff

- Workflow- und MCP-gebundene Agents mit mehreren Tool-Integrationen

Wichtig für den Search Intent ist auch die Abgrenzung: Jailbreaking ist meist eine Unterform direkter Prompt Injection. RAG Poisoning betrifft die vergiftete Wissens- oder Retrieval-Ebene. Prompt Injection beschreibt dagegen die eigentliche Laufzeitmanipulation, bei der ein Agent fremde Instruktionen als handlungsleitend übernimmt.

Wie funktioniert Prompt Injection?

Ein Agent erhält eine legitime Aufgabe, etwa eine Webseite zusammenzufassen, E-Mails zu priorisieren, ein Ticket zu bearbeiten oder Codekontext zu analysieren.

Im Lauf der Aufgabe liest der Agent untrusted Inhalte aus einer externen Quelle wie Web, PDF, E-Mail, RAG, Screenshot, Repo oder Tool-Output.

In diesem Inhalt stecken offene oder versteckte Instruktionen, zum Beispiel Aufforderungen zum Ignorieren bestehender Regeln, zu weiteren Datenabrufen oder zu bestimmten Tool-Aufrufen.

Weil Daten und Instruktionen nicht sauber getrennt sind, behandelt das Modell Teile dieses Inhalts als relevante Anweisung statt nur als zu verarbeitende Information.

Dadurch kippen Antwort, Plan, Tool-Auswahl oder Parameter in eine neue Richtung, die nicht mehr dem freigegebenen Nutzerauftrag entspricht.

Am Ende entstehen reale Folgen wie manipulierte Zusammenfassungen, Datenabfluss, unerlaubte Tool-Calls, persistente Fehlsteuerung oder ein Einstieg in weitere Threats.

flowchart TB

task[Legitime Aufgabe für den Agenten]

sources[Untrusted Inhalt aus Prompt, Web, Mail, PDF, Repo oder Tool-Output]

payload[Versteckte oder offene Instruktion]

merge[Agent vermischt Daten und Anweisungen im selben Kontext]

drift[Plan, Tool-Wahl oder Antwort kippt]

action[Unsicherer Tool-Call, Datenzugriff oder manipulierter Output]

impact[Business Impact]

leak[Data Leakage]

misuse[Tool Misuse]

poison[Memory oder Folge-Workflow wird kontaminiert]

task --> sources --> payload --> merge --> drift --> action --> impact

impact --> leak

impact --> misuse

impact --> poison

classDef normal fill:#ffffff,stroke:#406749,stroke-width:1.5px,color:#181c1e;

classDef warning fill:#f1f4f7,stroke:#406749,stroke-width:1.5px,color:#181c1e;

classDef danger fill:#fdeceb,stroke:#844f59,stroke-width:1.5px,color:#181c1e;

class task,sources,payload,merge warning;

class drift,action,impact normal;

class leak,misuse,poison danger;

Die gefährlichste Variante in Unternehmen ist meist indirekte Prompt Injection. Der Angreifer spricht den Agenten dabei nicht direkt an, sondern platziert Anweisungen in Inhalten, die der Agent später “nur lesen” soll. Genau deshalb sind Input Validation & Prompt Injection Defense, Output Validation und Guardrails und Human-in-the-Loop zusammen wichtiger als ein einzelner System Prompt.

Direkte vs. indirekte Prompt Injection und verwandte Threats

Viele Suchanfragen vermischen mehrere Begriffe. Für Architektur, Detection und Mitigation lohnt sich die Trennung trotzdem:

Begriff | Kernproblem | Abgrenzung |

|---|---|---|

Direkte Prompt Injection | Der Angriff kommt direkt über Chat-, API- oder Formular-Input. | Meist leichter sichtbar, aber nicht automatisch weniger schädlich, wenn der Agent Tools oder breite Rechte besitzt. |

Indirekte Prompt Injection | Die Instruktion steckt in Webseiten, PDFs, E-Mails, Repos oder Tool-Outputs, die der Agent später verarbeitet. | Besonders relevant für produktive Agenten, weil der Angriff über normale Content-Kanäle und ohne direkte Nutzerinteraktion erfolgt. |

Jailbreaking | Sicherheitsgrenzen oder Policies sollen aktiv umgangen werden. | Häufig eine Unterform direkter Prompt Injection, aber nicht jeder Prompt-Injection-Fall ist ein klassischer Jailbreak. |

RAG Poisoning | Wissensquellen, Retrieval-Indizes oder Dokumentensammlungen werden manipuliert. | Das ist ein anderer Layer. RAG Poisoning kann Prompt Injection ermöglichen, ersetzt den Begriff aber nicht. |

Tool Misuse | Der Agent führt einen falschen oder zu weitreichenden Tool-Call aus. | Das ist oft die Folge erfolgreicher Prompt Injection und markiert den Übergang von Kontextmanipulation zu realem Seiteneffekt. |

Für produktive Systeme heißt das: Ein besser formulierter Prompt allein löst das Problem nicht. Wer Prompt Injection ernsthaft reduzieren will, muss untrusted Content Handling, Rechtebegrenzung, Laufzeitkontrollen und Detection gemeinsam designen.

Realistische Beispiele für Prompt Injection bei KI-Agenten

Szenario 1

E-Mail-Agent mit versteckter Exfiltrationslogik

Ein Agent soll Meeting-Anfragen, Vertragsmails oder Support-Nachrichten vorsortieren. Eine scheinbar harmlose E-Mail enthält versteckte Instruktionen, die den Agenten zu weiteren Datenabrufen oder zur Weiterleitung interner Inhalte bewegen.

Aus einem Leseworkflow wird ein Outbound- und Data-Leakage-Pfad, obwohl der Nutzer dem Agenten nie einen Export- oder Sendeauftrag gegeben hat.

Szenario 2

RAG- oder Research-Agent liest manipuliertes Dokument

Ein interner Assistant soll ein PDF, eine Richtlinie oder eine externe Webseite zusammenfassen. Das Dokument führt jedoch neue Anweisungen ein, etwa Quellen zu ignorieren, weitere Daten anzufordern oder bestimmte Aussagen bevorzugt auszugeben.

Die Zusammenfassung wird fachlich falsch, wichtige Einschränkungen verschwinden oder der Agent startet Folgeaktionen, die mit dem eigentlichen Rechercheauftrag nichts zu tun haben.

Szenario 3

Coding Agent übernimmt Instructions aus Issue oder PR

Ein Coding Agent verarbeitet Repo-Kommentare, PR-Beschreibungen oder Tool-Output aus Tests und Shell. Angreifer platzieren dort Anweisungen, die Tokens suchen, riskante Kommandos vorschlagen oder lokale Dateien priorisieren.

Der Agent erzeugt unsichere Codeänderungen, liest unnötig sensitive Dateien oder bereitet den Weg für spätere Code-Ausführung und weitere Sicherheitsvorfälle.

Szenario 4

Browser-Agent wird über sichtbare Seitentexte fehlgesteuert

Ein Browser- oder Computer-Use-Agent soll Daten auf einer Webseite prüfen. Die Seite enthält sichtbare oder versteckte Handlungsanweisungen, die den Agenten zu weiteren Klicks, Formularaktionen oder Datensammlungen bewegen.

Der Agent nutzt legitime Browser-Fähigkeiten für unautorisierte Navigations- oder Exfiltrationsschritte und fällt damit in Richtung Tool Misuse oder Goal Hijack.

Welche Risiken entstehen für Unternehmen?

Prompt Injection ist für Unternehmen kein reines Qualitätsproblem. Sobald Agenten mit Daten, Identitäten und Tools verbunden sind, wird aus manipulierter Sprache ein operatives Sicherheitsrisiko.

Sensitive Data Disclosure und Data Leakage

Ein fehlgesteuerter Agent kann interne Dokumente, Chat-Verläufe, CRM-Daten, Zugangsinformationen oder vertrauliche Zusammenhänge offenlegen. Besonders kritisch ist das in RAG-, E-Mail- und Workspace-Workflows.

Passende Best Practice: Data Protection und PrivacyTool Misuse mit echten Seiteneffekten

Wenn der Agent schreiben, senden, exportieren oder browsen darf, führt Prompt Injection nicht nur zu falschem Text, sondern zu unerlaubten Aktionen in realen Systemen.

Verwandter Threat: Tool Misuse und ExploitationIntegrity-Verlust in Analysen, Empfehlungen und Freigaben

Manipulierte Summaries, verzerrte Priorisierungen oder unzuverlässige Risikoaussagen können Managemententscheidungen, Support-Antworten, HR-Bewertungen oder Security-Workflows falsch steuern.

Verwandter Threat: Agent Goal HijackPersistente Fehlsteuerung über Memory und Folgesysteme

Wird manipulierte Steuerlogik in Session-Summaries, Planner-State oder Langzeit-Memory übernommen, taucht der Angriff später erneut auf und wird deutlich schwerer zu forensisch aufzuklären.

Verwandter Threat: Memory and Context PoisoningIn regulierten Umgebungen kommen dazu Audit-, Datenschutz- und Governance-Risiken. Ohne belastbares Monitoring und Logging bleibt häufig unsichtbar, welcher untrusted Inhalt die spätere Aktion eigentlich ausgelöst hat.

Wie verhindert man Prompt Injection?

Vollständig lösen lässt sich Prompt Injection heute nicht. In produktiven Agentensystemen geht es deshalb um Risikoreduktion und Begrenzung des Blast Radius, nicht um ein einzelnes perfektes Prompt-Rezept.

Trusted und untrusted Kontext technisch trennen

Systemregeln, Developer-Policies und freigegebene Nutzeraufträge dürfen nicht in denselben privilegierten Kanal fallen wie Webseiten, E-Mails, PDFs oder Tool-Outputs. Genau diese Trennung reduziert direkte und indirekte Prompt Injection am stärksten.

Mehr zu Input Validation & Prompt Injection DefenseInput, Dokumente und Tool-Outputs vor der Übernahme filtern

Normalisierung, Sanitization, Klassifikation und sichere Extraktion müssen nicht nur für Chat-Eingaben gelten, sondern für jeden prompt-wirksamen Kanal. Dazu gehören RAG-Treffer, Browser-Inhalte, Screenshots und Tool-Responses.

Mehr zu Prompt ValidationAgentenrechte und Tool-Scope hart begrenzen

Least Privilege, read-only Defaults, enge Scopes, getrennte Identitäten und kleine spezialisierte Tools begrenzen den Schaden, wenn ein Agent trotzdem manipuliert wird.

Mehr zu Least Privilege & Tool SecurityRiskante Tool-Calls serverseitig validieren und freigeben

Tool-Name, Parameter, Zielressource, Empfänger und Wirkungsradius müssen vor der Ausführung gegen Policies geprüft werden. Für externe Kommunikation, Löschungen, Exporte oder Rechteänderungen braucht es zusätzlich Human Approval.

Mehr zu Output Validation und GuardrailsMemory und Folgekontexte gegen Persistenz absichern

Manipulierter Inhalt darf nicht still in Session-Summaries, Langzeit-Memory oder geteilte Agentenkontexte aufsteigen. Write-Validation, Provenance, TTL und Quarantäne sind hier wichtiger als reines Prompt Hardening.

Mehr zu Memory and Context SecurityRed Teaming, Evals und Betriebsfeedback fest einplanen

Produktive Abwehr bleibt nur wirksam, wenn direkte und indirekte Injection-Pfade regelmäßig getestet, Guardrails nachgeschärft und neue Umgehungsmuster über Telemetrie sichtbar gemacht werden.

Mehr zu Security Quality Assurance and TestingEin belastbarer Stack kombiniert diese Maßnahmen meist mit Human-in-the-Loop, AI Sandboxing für Browser- oder Coding-Agents und Monitoring und Observability für Detection und Forensik.

Wie erkennt man Prompt Injection?

Es gibt selten ein einzelnes Signal. In der Praxis funktioniert Detection über die Kombination aus Content-Signalen, Verhaltensanomalien und Zugriffspfaden.

- Dokumente, Prompts oder Tool-Outputs enthalten Muster wie ignore previous instructions, Rollenwechsel, obfuskierte Anweisungen, Encodings oder ungewöhnliche HTML- und Markdown-Strukturen

- ein Agent führt nach der Aufnahme untrusted Inhalts plötzlich Tool-Calls aus, die nicht zum sichtbaren Nutzerauftrag passen

- zwischen Content-Ingestion, Datenzugriff und Outbound-Aktion entsteht eine ungewöhnliche Kette, etwa lesen, mehr Daten sammeln und danach senden oder exportieren

- Antworten und Zusammenfassungen widersprechen den eigentlichen Quellen oder blenden relevante Einschränkungen ohne fachlichen Grund aus

- Guardrails, Prompt Shields oder Klassifikatoren markieren Requests als detected, filtered oder high risk

- dieselbe Quelle oder derselbe Prompt führt überproportional oft zu Policy-Hits, Scope-Erweiterungen oder unerwarteten Review-Events

Wichtig sind dabei nicht nur Modell-Logs, sondern auch Dokument-Hashes, Herkunft von Retrieval-Treffern, Tool-Parameter, Freigabeereignisse und Policy-Entscheidungen. Genau deshalb ist Agent Observability für Prompt Injection kein optionales Debugging-Feature, sondern Teil der Sicherheitsarchitektur.

FAQ zu Prompt Injection bei KI-Agenten

Was ist Prompt Injection bei KI-Agenten?

Prompt Injection ist ein Angriff, bei dem ein KI-Agent durch direkte oder indirekte Anweisungen dazu gebracht wird, seinen eigentlichen Auftrag oder Sicherheitsregeln zu missachten. Bei Agenten ist das besonders riskant, weil sie nicht nur Text erzeugen, sondern Daten lesen, planen und Aktionen ausführen können.

Was ist der Unterschied zwischen direkter und indirekter Prompt Injection?

Direkte Prompt Injection kommt über die Nutzereingabe oder einen API-Request. Indirekte Prompt Injection versteckt sich in externen Inhalten wie Webseiten, Dokumenten, E-Mails, Repos oder Tool-Outputs, die der Agent später verarbeitet.

Ist Jailbreaking dasselbe wie Prompt Injection?

Nicht ganz. Jailbreaking ist meist eine Unterform von Prompt Injection, bei der Sicherheitsgrenzen oder Policies aktiv umgangen werden sollen. Prompt Injection ist der breitere Begriff für die Manipulation des Modell- oder Agentenverhaltens.

Kann RAG Prompt Injection verhindern?

Nein. RAG vergrößert die Angriffsoberfläche oft sogar, weil externe Inhalte in denselben Entscheidungsraum aufgenommen werden. Ohne saubere Trennung von Daten und Instruktionen, gute Filter und harte Laufzeitkontrollen bleibt der Agent anfällig.

Können PDFs, Webseiten oder E-Mails einen KI-Agenten manipulieren?

Ja. Genau diese indirekten Pfade gelten heute als zentrale Angriffsoberfläche für produktive Agenten. Besonders betroffen sind Browser-, Dokumenten-, E-Mail- und Research-Workflows mit weiteren Tool-Rechten.

Kann man Prompt Injection vollständig verhindern?

Nach heutigem Stand nein. Belastbare Verteidigung bedeutet schichtweise Risikoreduktion: untrusted Content Handling, Least Privilege, Runtime-Guardrails, Human Approval, Logging und regelmäßige Tests. Ein einzelner System Prompt reicht nicht aus.

Welche Schutzmaßnahmen helfen am meisten?

Der größte Hebel liegt meist in der Trennung von trusted und untrusted Kontext, validierten Eingangs- und Tool-Kanälen, enger Rechtevergabe, serverseitiger Policy-Prüfung, Human-in-the-Loop für High-Risk-Aktionen und guter Telemetrie für Detection und Forensik.

Wie erkennt man Prompt Injection in der Praxis?

Auffällig sind obfuskierte Instruktionen, Policy-Hits, unpassende Tool-Aufrufe, verdächtige Datenzugriffe und Ketten aus Content-Ingestion gefolgt von Export, Versand oder Scope-Wechsel. Ohne gute Logs für Quellen, Tools und Freigaben bleibt der Angriff oft unsichtbar.